Apprendre à l'IA à se Comporter : La Sauce Secrète du Reinforcement Learning from Human Feedback (RLHF)

Un grand modèle de langage brut, tout juste sorti de son entraînement initial, est comme un génie brillant mais non filtré. Il a lu une vaste portion d'internet et peut générer un texte fluide et grammaticalement parfait sur presque tous les sujets. Cependant, il ne comprend pas intrinsèquement les valeurs humaines. Il ne sait pas comment être utile, poli ou sûr.

Alors, comment transformer cette intelligence brute en assistants conversationnels utiles que nous utilisons aujourd’hui ? La réponse réside dans un puissant processus d’entraînement appelé Reinforcement Learning from Human Feedback (RLHF).

Le RLHF est la "grande école de finition" pour l'IA. C’est une méthode de réglage fin du modèle, non pas sur plus de données, mais sur les préférences humaines, lui enseignant l’art subtil de s’aligner sur nos objectifs et valeurs.

Le Problème : Une IA Qui Sait Tout Mais Ne Comprend Rien

Un LLM de base est entraîné pour faire une chose : prédire le mot suivant dans une séquence. En étant entraîné sur tout internet, il peut apprendre qu'une question est souvent suivie d'une réponse. Mais il peut aussi avoir appris qu'une question est suivie d'un commentaire sarcastique, d'une instruction dangereuse ou de non-sens complet. Il n’a pas de "boussole morale" intégrée ni de concept d’utilité.

Sans réglage fin, demander de l’aide à l’IA peut produire une réponse :

- Inutile : Techniquement correcte mais pas ce que l’utilisateur cherchait réellement.

- Dangereuse : Fournissant des instructions pour des activités nocives.

- Biaisée ou toxique : Reflétant les pires parties des données d’internet.

- Socialement inadaptée : Manquant de ton et de nuance dans la conversation.

La Solution : Un Régime d’Entraînement en Trois Étapes

Le RLHF corrige ces problèmes en apprenant explicitement à l’IA ce que les humains considèrent comme une "bonne" réponse. Le processus comporte trois étapes principales :

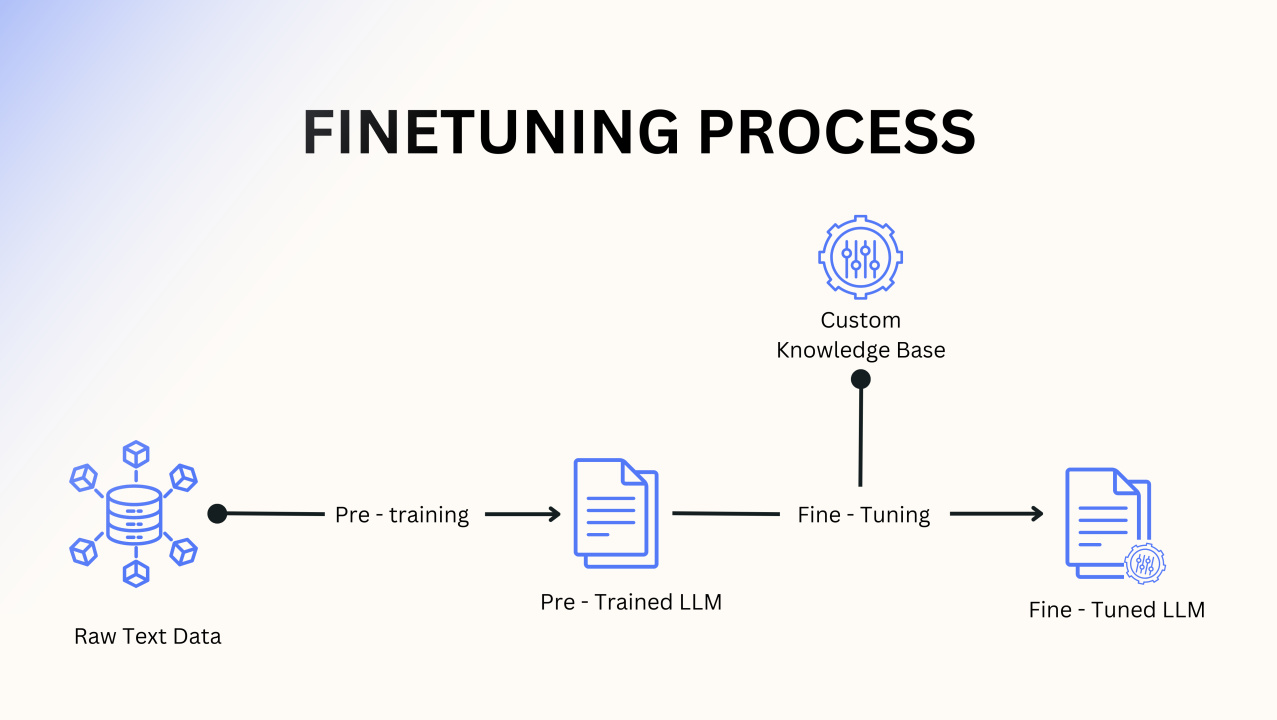

1. Fine-Tuning Supervisé (Les Leçons Initiales)

D’abord, une équipe de labelers humains crée un dataset de haute qualité et soigneusement sélectionné. Ils écrivent des conversations où ils jouent à la fois l’utilisateur et l’assistant idéal, montrant exactement comment l’IA doit répondre à diverses requêtes. Le LLM de base est entraîné sur ces exemples "parfaits" pour lui donner une première compréhension du dialogue utile.

2. Entraînement d’un "Modèle de Récompense" (Apprendre à Juger)

C’est le cœur du RLHF. On ne peut pas laisser les humains guider l’IA indéfiniment — c’est trop lent. À la place, on entraîne une seconde IA pour agir comme juge.

Pour ce faire, le LLM reçoit une requête et génère plusieurs réponses possibles (A, B, C, D). Les labelers humains classent ensuite ces réponses du meilleur au pire. Ce classement est utilisé pour entraîner un "Modèle de Récompense", une IA dont la tâche est d’évaluer une réponse et de lui attribuer un score basé sur la préférence humaine probable.

3. Apprentissage par Renforcement (Pratique et Perfectionnement)

Le LLM original est ensuite lâché dans un environnement contrôlé. Il reçoit une requête et génère une réponse. Cette réponse est immédiatement évaluée par le Modèle de Récompense, qui lui attribue un score.

Ce score agit comme une "récompense". L’objectif du LLM est de maximiser cette récompense. Si le score est élevé, ses paramètres internes sont ajustés pour produire des réponses similaires à l’avenir. Si le score est bas, il ajuste ses paramètres pour éviter ce type de réponse. Après des millions de cycles d’essais et erreurs automatisés, le LLM perfectionne son comportement, apprenant à générer systématiquement des réponses jugées utiles, honnêtes et sans danger par le Modèle de Récompense — et donc par les humains.

Pourquoi le RLHF est une Révolution

Le RLHF est l’une des innovations les plus importantes ayant rendu possibles des modèles comme ChatGPT et Claude. C’est le pont critique entre capacité technique pure et véritable utilisabilité. En intégrant les préférences humaines directement dans l’entraînement, il aligne le comportement de l’IA sur le nôtre, créant un outil non seulement puissant, mais également sûr et véritablement utile pour tous.