La Carte Secrète de l’IA : Comprendre les Vector Embeddings

Pour un ordinateur, le mot “chiot” n’est qu’une suite de lettres : c-h-i-o-t. Le mot “chaton” est une autre suite : c-h-a-t-o-n. L’ordinateur n’a aucune compréhension innée que ces deux concepts sont similaires — ce sont tous deux de jeunes animaux mignons. Alors, comment l’IA apprend-elle le riche réseau de relations que les humains saisissent si facilement ?

La réponse se trouve dans un concept clé appelé Vector Embeddings, une méthode ingénieuse pour traduire le sens de tout — mots, images, musiques — dans un langage mathématique universel.

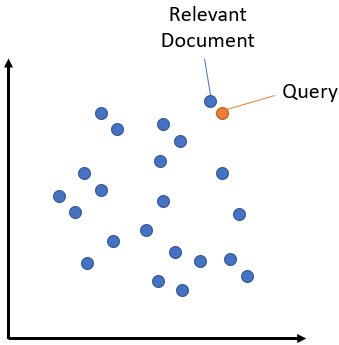

Les vector embeddings sont comme donner à chaque concept une coordonnée spécifique sur une gigantesque carte multidimensionnelle du sens. Sur cette carte, les concepts similaires sont placés à proximité, tandis que les concepts sans rapport sont éloignés.

Le Problème : Les Ordinateurs Ne Comprennent Pas le Sens

Avant l’IA moderne, les moteurs de recherche et les programmes étaient très littéraux. Si vous cherchiez “conseils pour prendre soin d’un petit chien”, vous n’obteniez que des résultats contenant exactement ces mots-clés. Le système ne savait pas qu’il devait également vous montrer un article utile intitulé “Comment élever un chiot heureux.”

Le problème fondamental est que les ordinateurs travaillent avec des nombres et une logique rigide, pas avec le sens abstrait. Ils voient les données sous leur forme brute :

- Texte : Une collection de caractères.

- Images : Une grille de valeurs de couleurs de pixels.

- Audio : Une forme d’onde de fréquences.

Il n’existe aucune connexion innée entre les pixels d’une photo de chat et les lettres du mot “félin”.

La Solution : Créer une Carte du Sens

Les vector embeddings résolvent ce problème en convertissant chaque élément de données en une liste de nombres appelée vecteur. Ce vecteur représente la position unique de cet élément sur la “carte du sens”. La magie réside dans le fait que le modèle d’IA apprend à créer ces coordonnées pendant son entraînement.

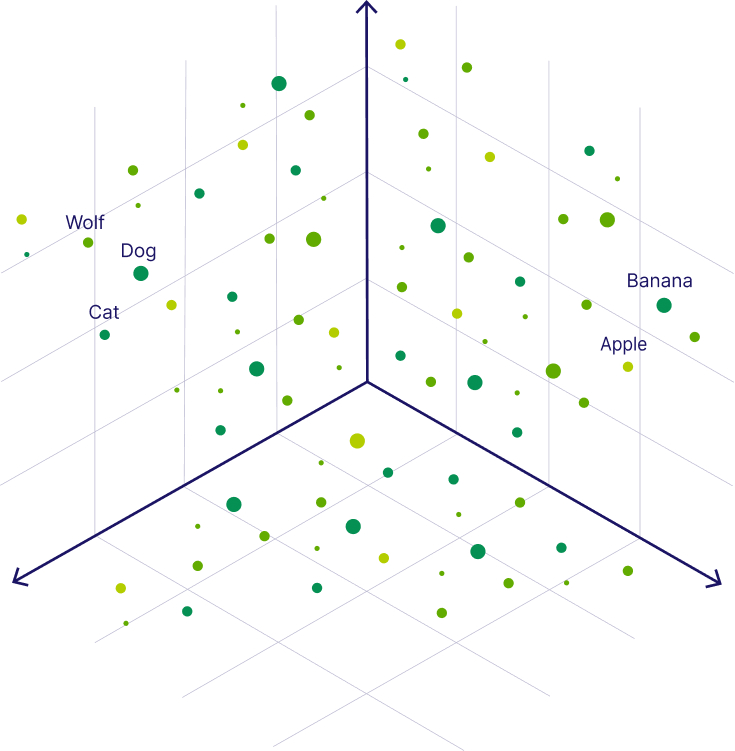

Le principe fondamental est simple : proximité = similarité.

- Le vecteur pour “Chien” sera très proche de celui pour “Chat”.

- Le vecteur pour “Pomme” sera proche de celui pour “Banane”.

- Mais le vecteur pour “Pomme” sera très éloigné de celui pour “Chat”.

Cette “carte” peut avoir des centaines, voire des milliers de dimensions. Nous ne pouvons pas la visualiser, mais les principes mathématiques restent les mêmes. Cet espace multidimensionnel est suffisamment riche pour capturer des relations extrêmement subtiles. Par exemple, une découverte célèbre montre qu’on peut faire des calculs sur ces vecteurs :

vecteur("Roi") — vecteur("Homme") + vecteur("Femme") ≈ vecteur("Reine")

Cela montre que le modèle n’a pas seulement appris des définitions ; il a appris le concept abstrait de genre et de royauté.

Pourquoi les Vector Embeddings Sont Révolutionnaires

Ce concept unique est une pierre angulaire de l’IA moderne et a débloqué d’innombrables applications :

- Recherche Sémantique : Vous pouvez chercher “nourriture que l’on mange avec les mains” et obtenir des résultats comme “burgers”, “tacos” ou “pizza”, même si vos mots exacts ne figurent pas dans le texte. Le système recherche des concepts, pas seulement des mots-clés.

- Moteurs de Recommandation Puissants : Quand vous regardez un film sur Netflix, le système trouve d’autres films situés près de lui sur la carte et vous les recommande.

- Un Langage Universel pour l’IA : Puisque tout peut être transformé en vecteur, les embeddings permettent à l’IA de trouver des relations entre différents types de données. Une IA peut apprendre que l’image d’un chien se trouve près du mot “chiot” sur la carte, ce qui est la base de l’IA multimodale.

- Alimentation des LLM : Les Large Language Models utilisent les embeddings pour comprendre les relations entre les mots, leur permettant de générer des phrases cohérentes et conscientes du contexte.

Les vector embeddings constituent la structure invisible qui permet à l’IA de dépasser le simple traitement des données et de commencer à comprendre le monde d’une manière étonnamment, et puissamment, humaine.