Les Opinions Cachées de l’IA : Qu’est-ce que le Biais de l’IA ?

Vous demandez à un générateur d’images IA de créer une image d’un "PDG à succès", et il ne montre que des hommes en costume. Vous utilisez un nouvel outil de recrutement pour trier des CV, et il semble favoriser des candidats venant de certains quartiers plutôt que d’autres.

Ce ne sont pas de simples coïncidences : ce sont des exemples de biais de l’IA. C’est l’un des défis les plus sérieux dans le domaine de l’intelligence artificielle, où une IA peut prendre des décisions injustes ou discriminatoires.

Imaginez une IA comme un étudiant qui apprend tout ce qu’il sait à partir d’un certain ensemble de livres. Si cet ensemble est rempli d’idées dépassées ou présente uniquement un point de vue, les connaissances de l’étudiant seront biaisées. L’IA fonctionne de la même manière.

Qu’est-ce que le Biais de l’IA ?

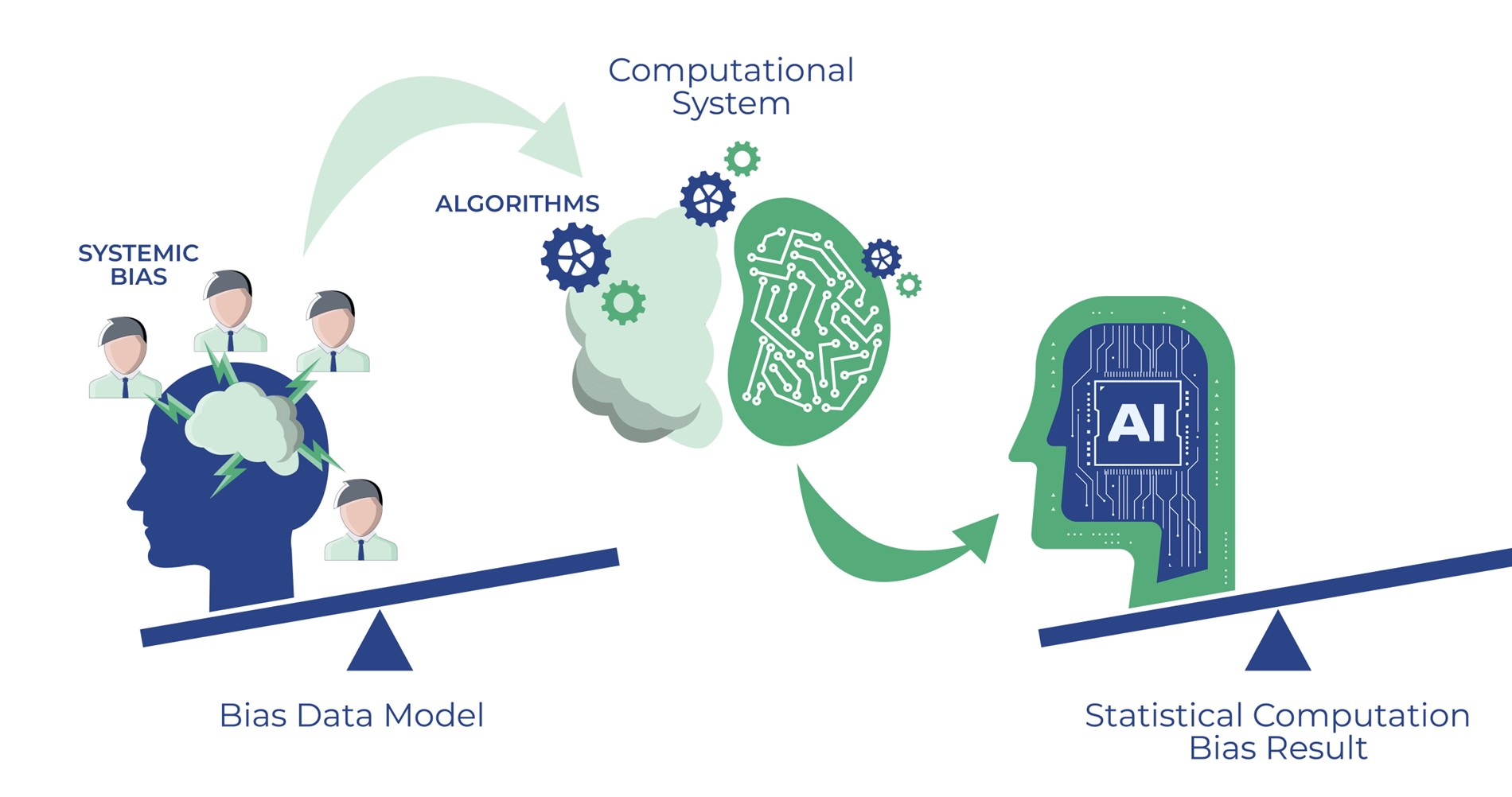

Le biais de l’IA se produit lorsqu’un système IA produit des résultats systématiquement défavorables à certains groupes de personnes. L’IA ne "pense" pas de manière biaisée ; elle reflète simplement les données sur lesquelles elle a été entraînée.

L’IA n’a pas d’opinions propres, mais elle peut reproduire les opinions cachées et les patterns injustes présents dans ses données d’apprentissage.

Exemples courants :

- Générateurs d’images : Créer des images stéréotypées à partir de prompts neutres (ex. : toutes les infirmières sont des femmes, tous les ouvriers du bâtiment sont des hommes).

- Outils de recrutement : Une IA entraînée sur les données passées d’une entreprise peut pénaliser injustement les candidates si l’entreprise embauchait historiquement plus d’hommes.

- Approbation de prêts : Un système peut refuser des prêts à des personnes de certains codes postaux parce que les données montrent qu’historiquement, moins de prêts y étaient accordés.

D’où vient le Biais ?

Une IA ne naît pas biaisée ; elle l’apprend. Voici les principales causes :

1. Données biaisées

C’est la cause principale. L’IA apprend à partir d’informations créées par des humains, et la société humaine a ses propres biais. Si une IA est entraînée sur des données historiques d’un monde avec des inégalités raciales ou de genre, elle apprendra ces mêmes patterns injustes. Règle simple : garbage in, garbage out.

2. Données insuffisantes

Imaginez que vous apprenez à une IA à reconnaître les chiens, mais que vous ne lui montrez que des golden retrievers. Ensuite, si vous lui montrez un chihuahua, elle pourrait ne pas le reconnaître comme un chien. La même chose se produit avec les humains : si les données d’entraînement de l’IA concernent principalement un seul groupe démographique, ses performances seront moins bonnes pour les autres.

3. Erreur humaine

Les personnes qui collectent et annotent les données pour l’IA peuvent introduire involontairement leurs propres biais inconscients, influençant ce que l’IA apprend finalement.

Pourquoi est-ce important ?

Le biais de l’IA n’est pas qu’un simple problème technique ; il a des conséquences réelles. Il peut conduire à ce que des personnes soient injustement privées d’emplois, de prêts ou même de soins médicaux. À mesure que l’IA est utilisée dans des domaines critiques, garantir son équité devient essentiel.

Que fait-on pour y remédier ? Les chercheurs et développeurs travaillent activement à résoudre ce problème en :

- Collectant soigneusement des données plus diversifiées et représentatives.

- Créant des outils pour tester les systèmes IA contre les biais avant leur mise en production.

- Concevant des IA plus transparentes sur leur processus de décision.

En tant qu’utilisateur, savoir que le biais de l’IA existe vous rend plus critique vis-à-vis de la technologie. Cela vous aide à questionner les résultats que vous voyez et à comprendre que, bien que l’IA soit un outil puissant, elle reflète le monde dont elle a appris — avec ses défauts.