Sio Ubongo Mmoja Tu, Bali Wengi: Jinsi Mixture of Experts (MoE) Inavyofanya AI Kuwa Hodari na Haraka

Kadri mifumo ya AI inavyoongezeka nguvu, ndivyo inavyokuwa kubwa sana. Kufundisha na kuendesha modeli hizi kubwa za "monolithic" kunahitaji nguvu kubwa sana za kompyuta, kufanya kuwa ghali sana na polepole. Lakini muundo mzuri unaoitwa Mixture of Experts (MoE) unabadilisha mchezo.

Badala ya ubongo mmoja mkubwa, mtaalamu wa jumla kujaribu kujua kila kitu, modeli ya MoE ni kama kamati ya wataalamu maalumu. Wakati swali linapowasilishwa, modeli hiyo inalituma kwa busara kwa wataalamu walio bora zaidi kushughulikia kazi hiyo.

Njia ya Kale: Modeli Yenye Uzito, Monolithic

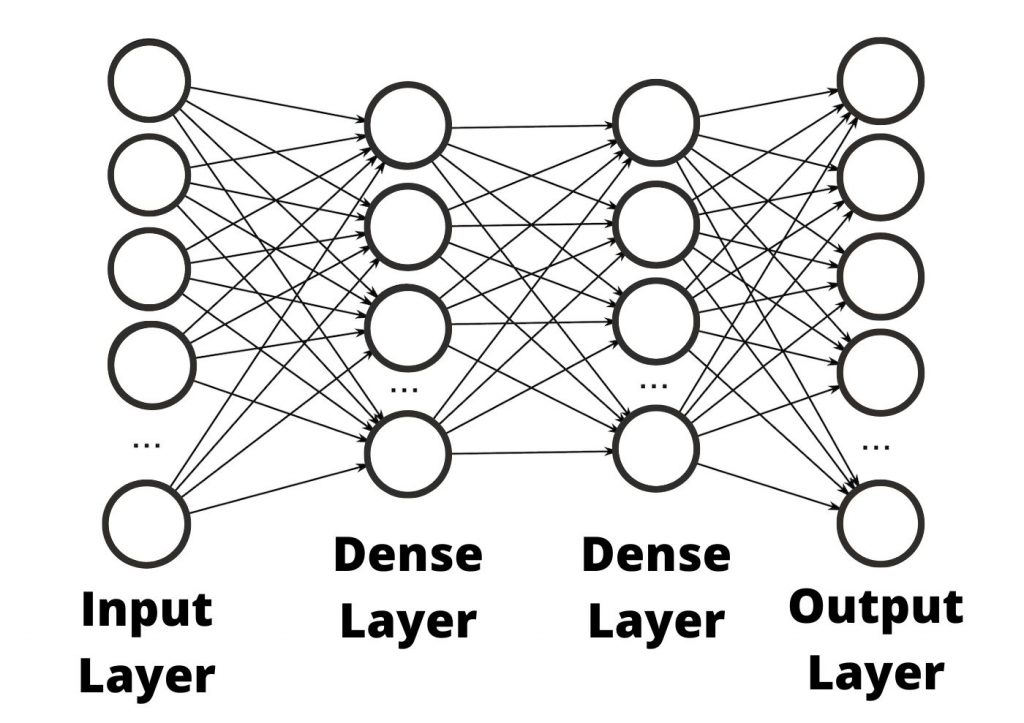

Kawaida, Large Language Models zilikuwa "nzito." Hii inamaanisha kila wakati unapoomba modeli swali—bila kujali jinsi ilivyo rahisi—mtandao mzima wa neva, wenye mamia ya mabilioni ya muunganiko, lazima uanze na kushughulikia taarifa.

Fikiria kama profesa mmoja anayejua kila kitu aliyeshinda kila somo. Ikiwa unamuuliza, "2+2 ni nini?", lazima atumie ubongo wake wote—sehemu zinazojua fizikia ya quantum, fasihi ya Shakespeare, na historia ya kale—ili kutoa jibu rahisi. Ni nguvu sana, lakini pia haifanyi kazi kwa ufanisi.

Njia Mpya: Kamati ya Mixture of Experts (MoE)

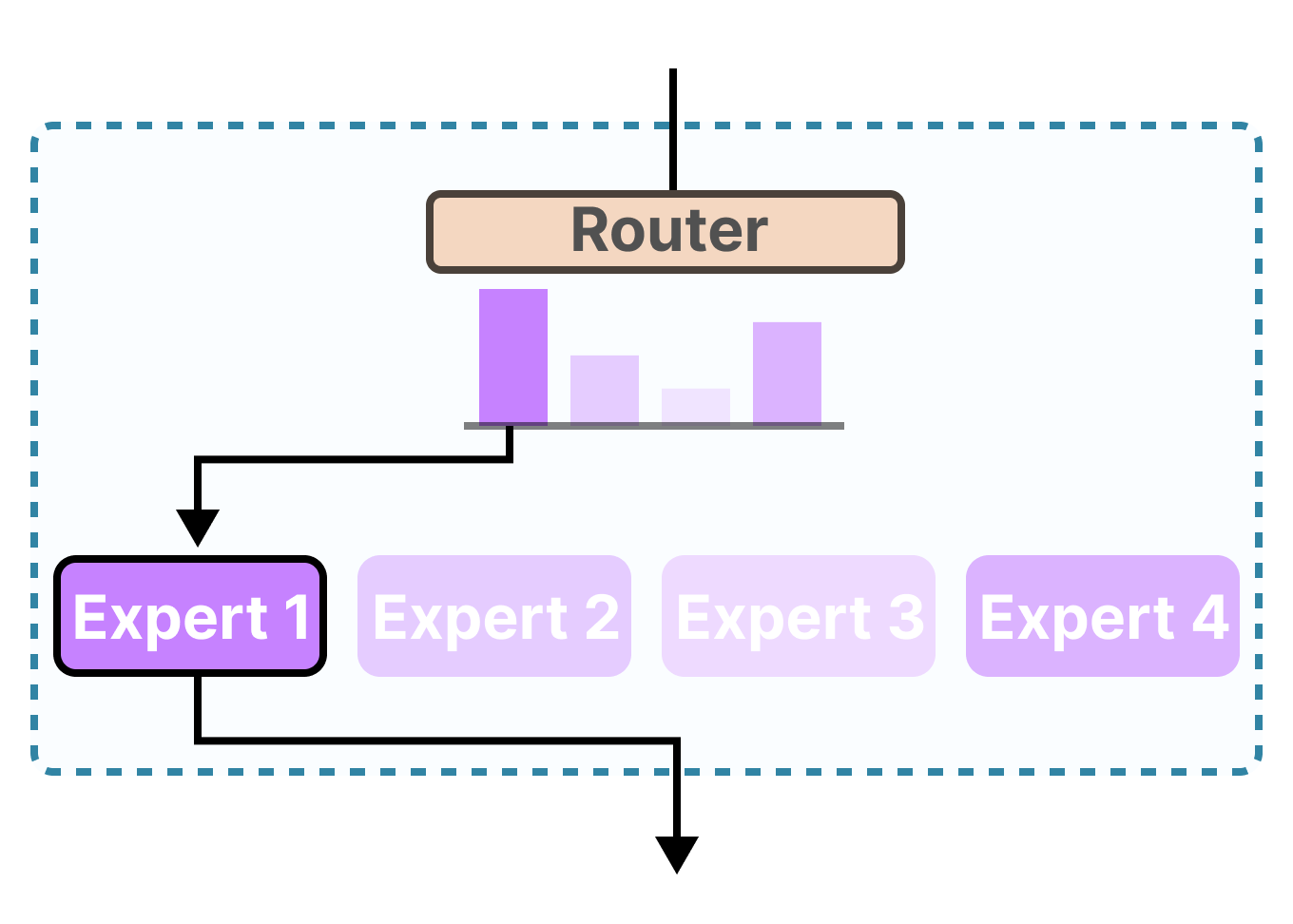

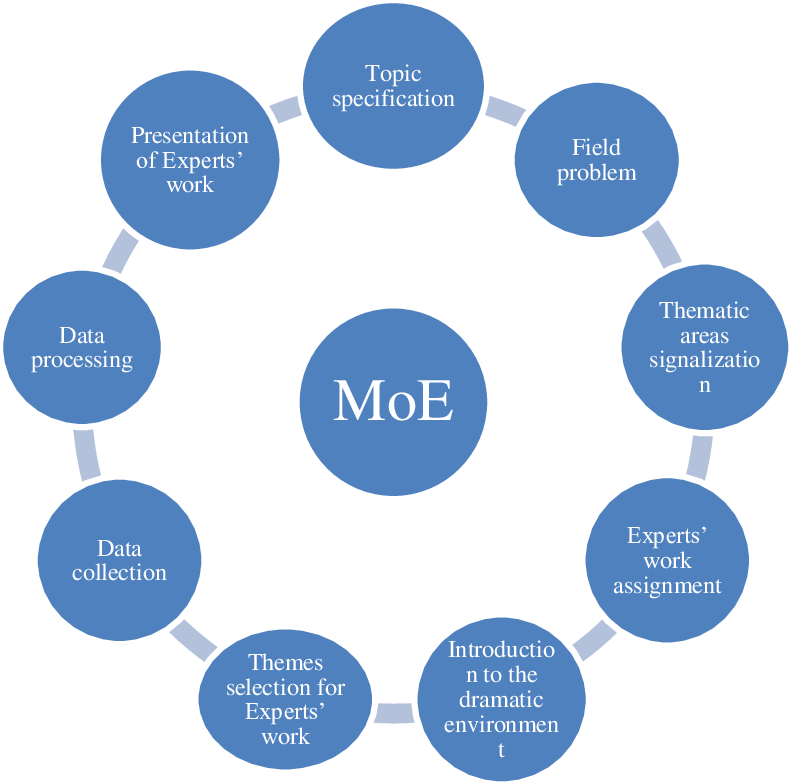

MoE inachukua njia ya "gawanya na shinda." Imegawanyika katika sehemu mbili muhimu:

- Wataalamu: Badala ya mtandao mmoja mkubwa, modeli imegawanywa katika mitandao midogo ya neva maalumu inayoitwa "wataalamu." Kila mtaalamu anaweza kuhitimisha ujuzi katika mada fulani, kama uandishi wa ubunifu, coding, uchambuzi wa historia, au ufahamu wa mantiki.

- Router: Huu ni mtandao mdogo, wenye ufanisi unaofanya kazi kama meneja wa mradi au mpokeaji. Kazi yake pekee ni kuangalia swali lililoingia na haraka kuamua ni mtaalamu gani au wawili kutoka kamati ndio bora kwa kazi hiyo.

Jinsi Inavyofanya Kazi:

Ukimuuliza MoE swali kama, "Andika script ya Python kuchambua data ya hisa ya kihistoria," yafuatayo hutokea:

- Router inachambua haraka prompt.

- Inaamua kuwa kazi hii inahitaji ujuzi wa programu na historia ya kifedha.

- Inaamsha tu "Python Coding Expert" na "Financial History Expert."

- Wataalamu wengine—kama "Poetry Expert" au "Biology Expert"—wanabaki wakiwa wamesimama, kuokoa nguvu.

- Wataalamu waliochaguliwa wanashirikiana kwenye tatizo na kutoa jibu la mwisho.

Faida Kubwa za MoE

Muundo huu mzuri una faida kubwa zinazopiga hatua uwanja mzima wa AI:

- Ufanisi Usioaminika: Kwa kuwa ni sehemu ndogo tu ya modeli inayotumika kwa kila swali, MoE inakuwa haraka na nafuu zaidi kuliko modeli nzito za ukubwa sawa. Hii ndiyo faida kubwa.

- Upanuzi Mkubwa: Watafiti wanaweza kujenga modeli yenye ujuzi mkubwa (kwa kuongeza wataalamu zaidi) bila kufanya modeli kuwa polepole zaidi. Unaweza kuwa na modeli yenye "parameters" trilioni, lakini inaweza kutumia bilioni 200 tu kwa kazi moja, ikifanya ionekane haraka.

- Utaalamu Bora: Kwa kuruhusu wataalamu kuzingatia ujuzi maalumu, modeli inaweza kukuza ujuzi wa kina katika nyanja maalumu, ikiwezekana kutoa matokeo bora kwa maswali changamano yenye vipengele vingi.

Modeli kama Mistral's Mixtral 8x7B na Grok kutoka xAI zimejengwa kwenye muundo huu. Zinaweka msingi wa siku zijazo ambapo AI inaweza kuwa na maarifa makubwa na haraka, zikileta hatua moja karibu zaidi kwa akili bandia yenye nguvu na inayopatikana.