Zaidi ya Maneno Pekee: Jinsi 'Attention' ya AI Inavyofungua Muktadha

Umeshawahi kusoma sentensi ndefu, ngumu na ukaona unapaswa kurudi mwanzo ili kukumbuka ni nani au ni nini ilikuwa inahusu? Modelle za AI za awali zilikuwa na tatizo lile lile, lakini kwa kiwango kikubwa. Ziliwahi kuwa na aina ya "kumbukumbu ya samaki wa dhahabu," zikishindwa kufuatilia muktadha kwa sehemu ndefu za maandishi.

Suluhisho la tatizo hili ni dhana ya mapinduzi inayoitwa Attention Mechanism. Ni kiambatanisho cha siri kinachomruhusu AI ya kisasa kuelewa lugha kwa undani na nuances ambazo mara nyingi tunazichukulia kuwa jambo la kawaida.

Attention inaruhusu AI "kuzingatia." Badala ya kuzingatia kila neno kwa usawa, inajifunza kutoa uzito na umuhimu zaidi kwa maneno maalumu yaliyo muhimu zaidi kwa kazi iliyoko mkononi, kama vile unavyotumia alama ya rangi kwenye kitabu cha masomo.

Njia ya Kale: Akili ya Njia Moja

Kabla ya Attention Mechanism, modeli zilizotawala za kuchakata lugha zilikuwa Recurrent Neural Networks (RNNs). RNN ingesoma sentensi neno kwa neno, kutoka kushoto kwenda kulia, ikijaribu kuweka muhtasari wa kile kilichosomwa hadi sasa katika "kumbukumbu" yake ya ndani.

Mchakato huu wa mlolongo ulikuwa na dosari kubwa. Wakati modeli ingefika mwisho wa aya ndefu, taarifa muhimu kutoka mwanzo mara nyingi zingepotea au kudhoofika kabisa.

Fikiria sentensi hii:

“The report on renewable energy trends, which was commissioned by the international committee and reviewed by three separate labs, finally showed it was a viable alternative.”

Wakati RNN rahisi ingefika kwenye neno “it,” kumbukumbu ya “the report” ingekuwa mbali sana na dhaifu kiasi kwamba modeli ingeshindwa kuunganisha.

Mapinduzi: Kujifunza Kuzingatia

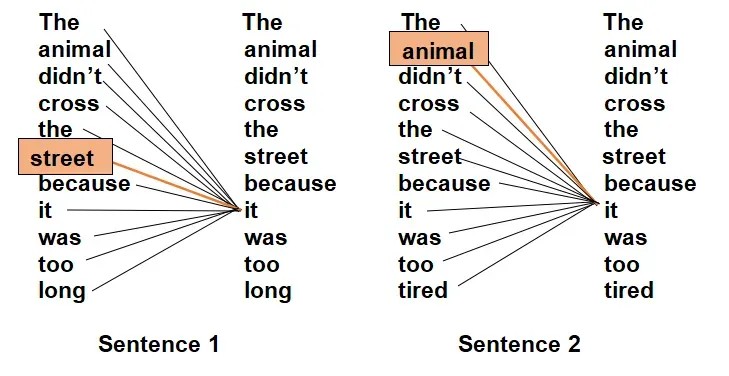

Attention Mechanism ilibadilisha mchezo kwa kuruhusu modeli kuangalia sentensi nzima kwa wakati mmoja. Badala ya njia moja ya moja, inaunda mtandao wa uhusiano kati ya maneno yote.

Hapa ni jinsi inavyofanya kazi kwa kiwango cha dhana:

- Kuweka Alama za Umuhimu: Wakati modeli inachakata kila neno, haangalii tu neno lenyewe. Inarudia nyuma kwa kila neno jingine katika sentensi na kuuliza, “Neno hili lina umuhimu gani kwa lile neno ninayolizingatia sasa?”

- Hesabu Uzito wa 'Kuzingatia': Inatoa alama ya nambari—“uzito wa attention”—kwa kila neno jingine. Alama kubwa zaidi inamaanisha umuhimu zaidi.

- Tengeneza Uelewa wa Muktadha: Baada ya hapo, modeli inatumia alama hizi kuunda uelewa mpya, wenye uzito wa neno. Neno halionekani tena kwa peke yake bali kama mchanganyiko wa lenyewe pamoja na maneno mengine yanayozingatiwa.

Katika sentensi yetu ya mfano, wakati modeli inachakata neno “it,” Attention Mechanism ingetoa alama ya juu sana kwa “the report” na alama ndogo kwa maneno yasiyo muhimu. Hii inaruhusu kujua, kwa karibu uhakika, kuwa “it” inarejelea ripoti.

Kwa Nini Attention Ilikuwa Mapinduzi

Uwezo huu wa kupima umuhimu wa maneno kwa wakati mmoja ulikuwa hatua kubwa mbele na uvumbuzi wa msingi nyuma ya usanifu wa Transformer wenye nguvu unaochochea modeli kama ChatGPT.

- Kutatua Muktadha wa Umbali Mrefu: Inafuta kabisa tatizo la "kumbukumbu ya samaki wa dhahabu." Neno mwishoni mwa hati linaweza sasa kuunganishwa kwa urahisi na neno mwanzoni.

- Kuruhusu Kuchakata Sambamba: Tofauti na RNNs, ambazo zilipaswa kuchakata maneno moja baada ya jingine, mahesabu ya attention yanaweza kufanywa kwa maneno yote kwa wakati mmoja. Hii iliwezesha kufundisha modeli kubwa na zenye nguvu kwa sehemu ya muda mdogo.

- Kuboresha Ufafanuzi: Unaweza kuona alama za attention ili kuona kile modeli inachozingatia, ikitupa mtazamo ndani ya “akili” ya AI.

Attention Mechanism inaruhusu AI kuelewa mtandao tata wa uhusiano katika lugha — kuelewa viwakilishi, kutatua utata, na kutoa maandishi ambayo si tu sahihi kwa sarufi, bali pia yanaendana na muktadha na yanayofaa.